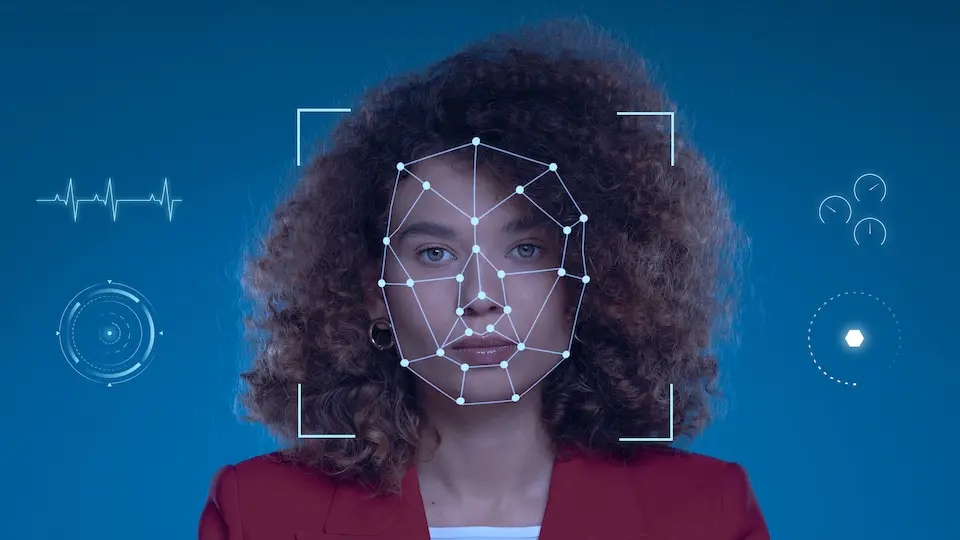

Preferidos por 73% dos brasileiros, os sistemas biométricos, que incluem reconhecimento facial, enfrentam ameaças e os golpes podem chegar a R$ 4,5 bilhões

Tokens e senhas já não são os métodos favoritos para acessar dispositivos ou contas pessoais. Dando lugar às impressões digitais, reconhecimento facial e até à análise da voz, os sistemas biométricos representam a nova fronteira na autenticação de transações.

Mais de 4,2 bilhões de dispositivos móveis já utilizam algum tipo de biometria ativa, segundo a Juniper Research, e a previsão é que, até o final de 2026, 57% de todas as transações digitais globais serão validadas por esses métodos. No Brasil, a adesão à tecnologia também já é uma realidade palpável. Uma pesquisa da Accenture mostra que 73% dos consumidores brasileiros se sentem mais seguros usando biometria do que os tradicionais códigos numéricos em aplicativos bancários e carteiras digitais.

E, infelizmente, isso também atrai a atenção dos criminosos cibernéticos. “Com o avanço das tecnologias biométricas, especialmente o reconhecimento facial, empresas e governos vêm reforçando sistemas de segurança com identificações automáticas de indivíduos. No entanto, esse movimento é acompanhado pelo cibercrime na busca por técnicas sofisticadas, alimentadas por Inteligência Artificial, capazes de burlar os sistemas de autenticação”, explica Anchises Moraes, Head de Threat Intelligencena Apura Cyber Intelligence S.A.

Segundo o especialista em cibersegurança, criminosos utilizam desde impressoras de alta resolução até softwares para falsificar características biométricas, desafiando a proteção tecnológica de aplicativos bancários, serviços públicos e plataformas financeiras.

Esses ataques podem ser classificados em cinco níveis de complexidade. O nível 1 utiliza fotos digitais de alta resolução, vídeos em HD e até máscaras de papel, enquanto o nível 2 se baseia em bonecos realistas e máscaras 3D de látex ou silicone. Já no nível 3, os fraudadores recorrem a artefatos ultra-realistas e cabeças de cera. O nível 4 envolve a alteração de mapas faciais 3D para enganar os servidores de autenticação quanto à “prova de vida”. O estágio mais avançado, nível 5, inclui a injeção digital de imagens e vídeos diretamente nos dispositivos, ou mesmo o uso de deepfakes altamente convincentes, levando sistemas a aceitar a fraude como se fosse atividade orgânica do usuário legítimo.

Fraudes com deepfake e uso de identidades digitais sintéticas têm crescido no Brasil. Relatórios, como o da Deloitte publicado pelo portal Infochannel, apontam que o prejuízo econômico com fraudes movidas por inteligência artificial pode chegar a R$ 4,5 bilhões até final de 2025. Crescimentos de mais de 800% no uso de deepfakes já foram observados.

Na China, um caso emblemático escancarou o potencial destrutivo desses golpes. Um empregado de uma estatal foi induzido a transferir US$ 622 mil (cerca de R$ 3,1 milhões) após conversar por vídeo com quem acreditava ser seu próprio CEO. O fraudador usou deepfake em tempo real para replicar a imagem e voz da liderança da empresa, produzindo uma situação de extrema urgência para forçar as transferências. O golpe usou vídeos públicos do executivo para criar o avatar, e golpes similares vêm sendo relatados desde então.

Anchises esclarece, portanto, que as empresas de cibersegurança têm apostado em múltiplas camadas de proteção para mitigar essas ameaças. Uma das principais estratégias é a adoção de sistemas multimodais: combina-se dados de vídeo, áudio, sensores de temperatura, profundidade e análise comportamental, dificultando a ação dos golpistas. Sistemas avançados também integram detecção de deepfakes em tempo real e biometria comportamental, que monitora detalhes como velocidade de digitação, pressão sobre o touchscreen e até a forma como o dispositivo é manuseado.

Outras táticas envolvem técnicas de desafio e resposta dinâmico, com desafios imprevisíveis gerados por IA (como pedir para piscar apenas um olho ou falar informações contextuais não planejadas), e a junção de provas de vida (“liveness”) passivas com ativas – mixando análises automáticas de vídeo com interações em tempo real. Ademais, cresce o monitoramento sistemático de vazamentos: equipes especializadas vasculham a dark web e bases de dados abertas em busca de imagens e perfis reciclados em novas tentativas de fraude. Apesar da sofisticação dos ataques, a resposta das empresas também evolui, demonstrando que a guerra pela identidade digital está apenas começando.

“Por isso se faz fundamental o trabalho desenvolvido pela Apura em conjunto com outras empresas de cibersegurança, ao monitorar as redes em busca de possíveis ameaças e, quando, infelizmente, um ataque for bem-sucedido, avaliar minuciosamente todos os fatores envolvidos para desenvolver e aprimorar ainda mais as táticas defensivas contra cibercriminosos que querem explorar as vulnerabilidades do uso de biometrias”, finaliza o especialista da Apura Cyber Intelligence.

Sobre a Apura Cyber Intelligence, acesse: apura.com.br